- Home

- Blog

- Strategische interne Link-Matrix mit KI und GSC-Daten

Aktualisiert am: 23.02.2026

Interne Verlinkung ist ein Eckpfeiler jeder erfolgreichen SEO-Strategie. Doch in der Praxis ist sie oft ein manueller, zeitaufwendiger Prozess, der mehr auf Bauchgefühl als auf harten Daten basiert. Man klickt sich durch die Website, sucht nach passenden Keywords und hofft, die richtige Verbindung zu finden. Mit dem Aufkommen von LLMs und dem semantischen Konzept der Embeddings hat sich in der SEO-Branche ein automatisierter Prozess bewährt, der den Aufbau einer zielführenden internen Verlinkung deutlich vereinfacht.

In der Praxis waren aber viele Online-Marketing-Teams mit dem Output dieses Prozesses schlichtweg überfordert. Daher haben wir die bereits vorhandenen Ansätze weitergedacht und einen automatisierten Arbeitsablauf entwickelt, der nicht nur Link-Chancen findet, sondern sie auch priorisiert, thematisch bündelt und direkt umsetzbare Ankertext-Empfehlungen liefert. Das Ergebnis ist keine unübersichtliche Excel-Tabelle, sondern ein strukturierter Multi-Sheet-Report für deine interne Verlinkung – inklusive Kannibalisierungs-Erkennung, Hub-Page-Analyse und Orphan-Page-Identifikation. Im vorliegenden Artikel dokumentieren wir dir die Systematik hinter unserem Analyse-Skript und zeigen, wie das Ergebnis deine tägliche SEO-Arbeit deutlich erleichtert.

TL;DR – das Wichtigste in Kürze

- Interne Verlinkung als SEO-Grundlage: Traditionell mühsam und manuell, lässt sich interne Verlinkung durch den Einsatz von KI und Screaming Frog automatisieren und strategisch effizienter gestalten.

- Technische Basis des Workflows: Screaming Frog crawlt Inhalte, extrahiert Embeddings, die per Python-Skript semantisch analysiert werden. Das Ergebnis sind präzise Link-Vorschläge auf Grundlage inhaltlicher Ähnlichkeiten.

- Mehrwert durch Datenintegration: Google-Search-Console-Daten fließen in die Bewertung ein, sodass Linkchancen anhand von Relevanz, Autorität und Klickpotenzial priorisiert werden.

- Thematische Cluster und Ankertexte: KI-basiertes Clustering bündelt URLs in Themenblöcke und liefert datengestützte, qualitativ hochwertige Ankertexte, die Nutzerintention und SEO gleichermaßen berücksichtigen.

- Gewichteter Opportunity Score: Der Bewertungsscore lässt sich projektspezifisch konfigurieren und berücksichtigt optional auch die GSC-Positionsdaten für einen Striking-Distance-Bonus.

- Erweiterte Analysen: Das Skript erkennt automatisch potenzielle Keyword-Kannibalisierung, identifiziert Hub-Page-Kandidaten und findet Orphan Pages ohne jegliche interne Verlinkung.

- Multi-Sheet Excel-Report: Das Ergebnis ist kein einzelnes Tabellenblatt, sondern ein strukturierter Report mit sieben Tabs – von der priorisierten To-do-Liste bis zur strategischen Cluster-Übersicht.

Interne Verlinkung und Embeddings: Ein paar Vorüberlegungen, Tools und Voraussetzungen für den Aufbau

Beginnen wir mit ein paar Vorüberlegungen zur internen Verlinkung. Der im Folgenden skizzierte Prozess versucht, die bewährten Ansätze von Mike King, Everett Sizemore, Gus Pelogia und Brittney Muller weiterzudenken. Die entsprechenden Beiträge, Skripte und Anleitungen sind in den weiterführenden Quellen am Ende verlinkt.

ScreamingFrog + ChatGPT = Embeddings

Ihnen allen gemeinsam ist die Verwendung des ScreamingFrog SEO Spider und eines gültigen API-Keys für ein LLM (siehe zu diesem Thema auch unseren Blogartikel „LLMs und SEO„). In den meisten Fällen ChatGPT, aber auch mit anderen Anbietern lassen sich die gewünschten Ergebnisse erzielen. Kurzum: Du benötigst die kostenpflichtige Version des ScreamingFrog (245 € + Steuern) und API-Credits für ChatGPT (bei OpenAI kommst du mit 20 € sehr, sehr weit; die API-Abfragen produzieren Kosten im Cent-Bereich). Das ist aber definitiv gut investiertes Geld.

Seit Version 20.0 lässt sich der Frosch per API mit LLM-System wie ChatGPT, Gemini und Co. für verschiedene automatisierte Anwendungsfälle verbinden. Uns interessiert für die interne Verlinkung primär das Extrahieren sogenannter Embeddings aus gecrawlten URLs.

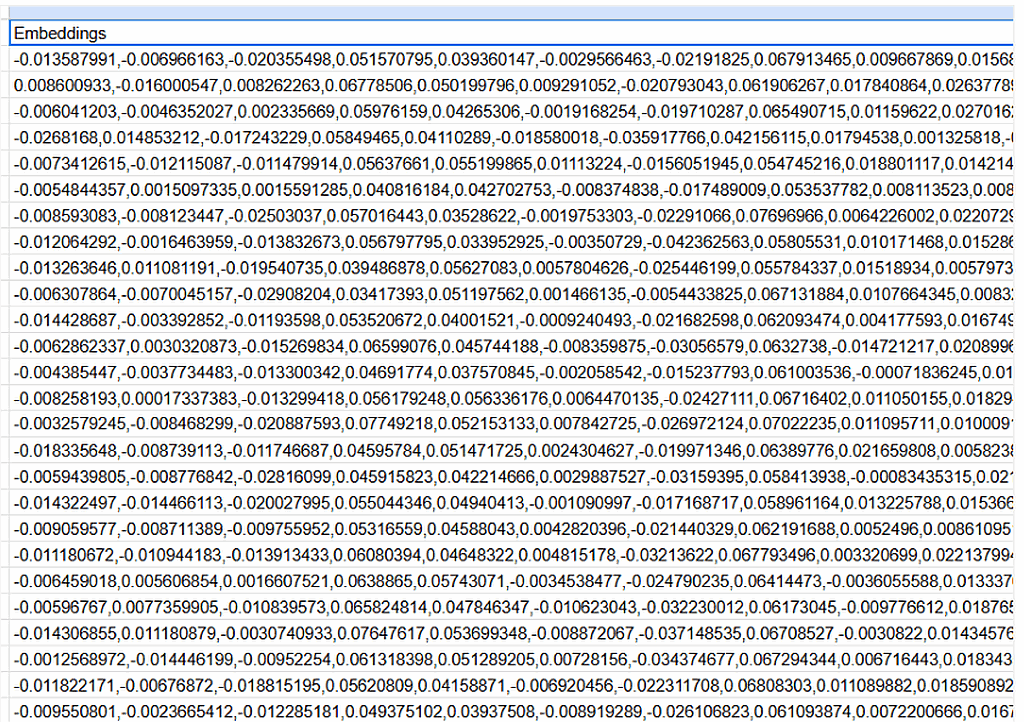

Diese sind im Prinzip eindeutige Nummern, die den Wörtern und Begriffen einer Seite zugewiesen werden. Sprich, der gefundene Content einer URL wird in maschinenlesbare Zahlenketten übersetzt. Für die interne Verlinkung bedeutet dies dann, dass sich per Python-Script (als kostenloses Colab-Notebook) die Cosinus-Ähnlichkeit für diese Zahlenketten (semantische) Verwandtschaftsbeziehungen berechnen lässt. Sprich, je ähnlicher sich die Zahlenwerte sind, desto höher ist auch die Wahrscheinlichkeit, dass sie eine inhaltliche Übereinstimmung besitzen. Perfekte Voraussetzungen für die interne Verlinkung. Besonders, wenn dies für eine Domain mit tausenden URLs durchgeführt werden muss.

Embeddings und URLs als Basis für die interne Verlinkung

Im Prinzip läuft dieser Analyseprozess wie folgt ab:

- Der ScreamingFrog crawlt die Website und extrahiert für jede URL die Embeddings der Inhalte.

- Alle internen Links und die Embeddings werden als separate CSV-Dateien exportiert.

- Ein Python-Script bereinigt die Daten (Fehler, Leerstellen usw.) und führt die exportierten Daten zusammen.

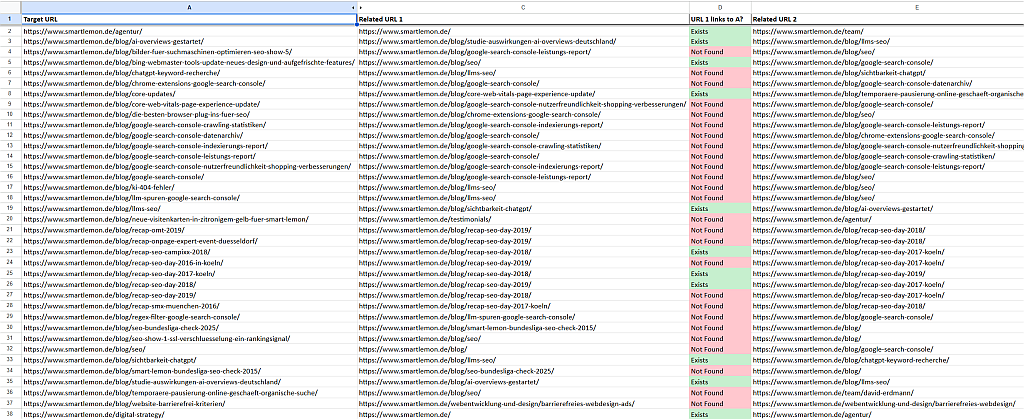

- Am Ende steht ein Dokument, das alle relevanten URLs einer Domain und die URLs zu den 5 am stärksten verwandten Seiten basierend auf der Kosinusähnlichkeit listet. Ferner markiert das Python-Script fehlende interne Verlinkungen.

Das hat sich in der Praxis bewährt und lässt sich auch problemlos durch eine(n) SEO mit etwas Erfahrung umsetzen. Je nach Größe der Domain (= Zahl der URLs) wird die finale Tabelle schnell unübersichtlich bzw. liefert keine Priorisierung. Und an dieser Stelle setzen wir an.

Benötigte Datenquellen: Was du für die Analyse benötigst

Um diesen automatisierten Workflow zu nutzen, benötigst du vier Exporte aus gängigen SEO-Tools. Das Skript ist so konzipiert, dass es die Spalten intelligent erkennt, auch wenn die Bezeichnungen leicht abweichen.

Link-Export (aus Screaming Frog): Eine Liste aller internen Links deiner Website (Bulk Export > All Inlinks).

Embeddings-Export (aus Screaming Frog): Die semantischen Vektoren deiner Seiteninhalte. Dies geschieht über eine Custom Extraction in Screaming Frog, die eine KI-API ansteuert.

Kombinierter GSC-Export (aus Looker Studio): Eine einzelne CSV-Datei, die Query, Landing Page, Clicks und Impressions enthält. Optional kann der Export auch eine Positions-Spalte enthalten. Ist diese vorhanden, aktiviert das Skript automatisch einen Striking-Distance-Bonus im Scoring, der Seiten auf den Positionen 8–20 bevorzugt – also Keywords mit dem höchsten Potenzial für schnelle Ranking-Verbesserungen durch interne Links. Dies ist der empfohlene Weg, um eine saubere Datenbasis zu erhalten. Alternativ kannst du dir die benötigten Daten bzw. deren Kombination auch mit den Google-Sheets-Erweiterungen „Search Analytics for Sheets“ oder „Seo Sheets“ ziehen. Beide Erweiterungen haben wir in den weiterführenden Quellen verlinkt. Mit einer solchen Extension lässt sich übrigens auch sehr einfach ein Google-Search-Console-Datenbackup durchführen.

- Seiten-Crawl (aus Screaming Frog): Der Standard-Export internal_all.csv, der Metadaten wie URL, H1 und Title enthält.

Die Systematik: Sieben Analyse-Ebenen für die perfekte Verlinkung

Unser Skript kombiniert diese vier Datenquellen in sieben Analyse-Ebenen, um eine umfassende und strategische Analyse zu ermöglichen. Die ersten vier Ebenen bilden die Datenbasis, die drei erweiterten Ebenen liefern zusätzliche strategische Erkenntnisse.

1. Semantische Ähnlichkeit: Verstehen, was wirklich zusammenpasst

Das Herzstück der Analyse sind Vector Embeddings. Anstatt nur nach übereinstimmenden Keywords zu suchen, wandelt eine KI den Inhalt jeder Seite in eine mathematische Repräsentation (einen Vektor) um.

- Wie es funktioniert: Das Skript vergleicht diese Vektoren und berechnet die „Cosinus-Ähnlichkeit“ zwischen allen Seiten. Ein hoher Wert bedeutet eine starke thematische Übereinstimmung

- Das Ergebnis: Wir finden die Top 5 der wirklich relevanten Verlinkungs-Partner für jede einzelne URL auf deiner Website.

Um die Qualität der Ergebnisse zu verbessern, arbeitet das Skript mit einem konfigurierbaren Mindest-Relevanz-Threshold. Seitenpaare, deren Cosinus-Ähnlichkeit unterhalb dieses Schwellenwerts liegt, werden automatisch herausgefiltert. Zusätzlich gibt das Skript eine Übersicht der Relevanz-Verteilung aus (Minimum, Median, Maximum, Durchschnitt), sodass du den Threshold bei Bedarf datenbasiert anpassen kannst.

2. GSC-Performance-Daten: Wert und Autorität messen

Relevanz allein reicht nicht aus. Ein Link ist dann am wertvollsten, wenn er von einer starken Seite auf eine wichtige Seite verweist. Um dies zu messen, nutzen wir ausschließlich Daten aus der Google Search Console.

- Wie es funktioniert: Wir verwenden den kombinierten GSC-Export.

Konfigurierbarer Opportunity Score: Die Gewichtung der einzelnen Faktoren (Relevanz, Impressionen, Klicks und der optionale Positions-Bonus) lässt sich über ein zentrales Konfigurationsfeld am Anfang des Skripts projektspezifisch anpassen. Bei einer neuen Domain mit wenig GSC-Daten kannst du beispielsweise die Relevanz hochgewichten und die Traffic-Metriken herunterdrehen.

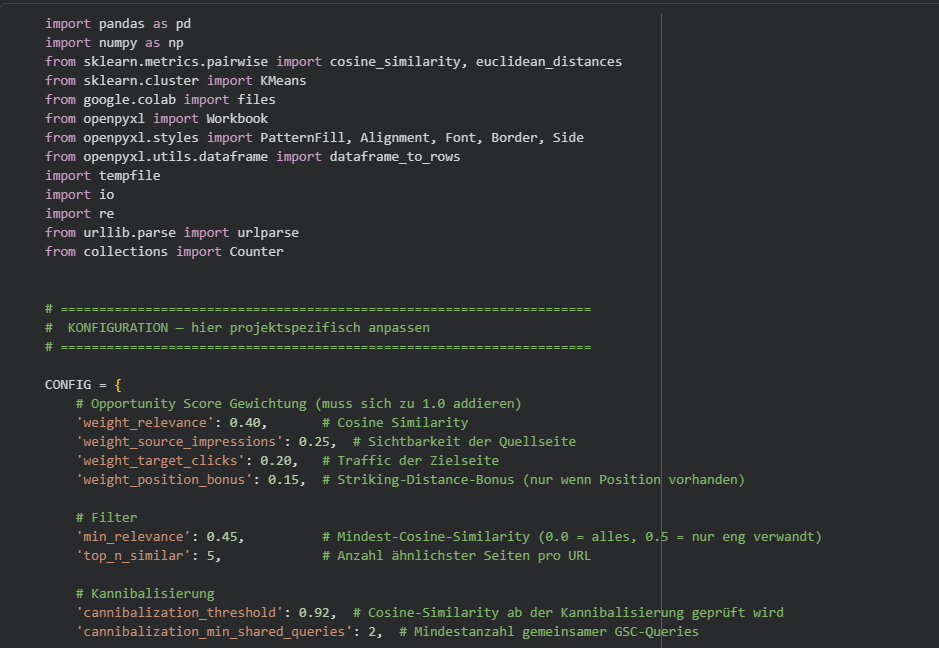

Konfiguration am Scriptanfang (CONFIG-Dictionary)

Das Skript lässt sich über ein zentrales Konfigurationsfeld am Anfang projektspezifisch anpassen – ohne im Code suchen zu müssen:

Scoring-Gewichte: Relevanz (40 %), Source Impressions (25 %), Target Clicks (20 %), Position-Bonus (15 %)

Min. Relevanz: 0,45 (Cosinus-Ähnlichkeit unter diesem Wert wird gefiltert)

Kannibalisierungs-Schwelle: Ab 0,92 Ähnlichkeit + mind. 2 gemeinsame Queries

Striking Distance: Position 8–20 (höchster Bonus)

Ähnliche Seiten pro URL: Top 5

Alle Werte sind frei anpassbar. Bei einer neuen Domain empfiehlt es sich, die Relevanz-Gewichtung zu erhöhen und die Traffic-Metriken zu reduzieren.

Striking-Distance-Bonus (optional): Enthält der GSC-Export eine Positions-Spalte, erhalten Zielseiten auf den Positionen 8–20 einen zusätzlichen Bonus. Diese „Striking-Distance-Keywords“ profitieren erfahrungsgemäß am stärksten von zusätzlichen internen Links.

- Wert der Zielseite: Wird über die Gesamtzahl der Klicks definiert, die eine Seite erhält.

- Autorität der Quellseite: Wird über die Gesamtzahl der Impressionen definiert. Eine Seite, die Google oft anzeigt, hat eine hohe Sichtbarkeit und damit eine hohe „interne Autorität“.

- Das Ergebnis: Wir können die Wichtigkeit von Quell- und Zielseite objektiv bewerten.

3. Thematisches Clustering: Strategische Blöcke bilden

Um die Topical Authority gezielt zu stärken, bündelt das Skript alle Seiten in thematische Cluster. Die Benennung dieser Cluster erfolgt dabei auf Basis deiner eigenen, bewusst gewählten Seitenarchitektur.

- Wie es funktioniert: Ein K-Means-Clustering-Algorithmus gruppiert die Seiten basierend auf der Ähnlichkeit ihrer Vektoren. Anschließend identifiziert das Skript für jeden Cluster die thematisch repräsentativste Seite. Der Verzeichnispfad dieser Seite wird zum Namen des Clusters.

- Beispiel: Die repräsentativste Seite eines Clusters ist /blog/was-ist-e-e-a-t/. Das Skript extrahiert den Pfad und benennt den Cluster SEO – Content-Marketing.

- Das Ergebnis: Jede Link-Chance wird einem klaren, strukturbasierten Themen-Cluster zugeordnet, was dir die strategische Bündelung von Maßnahmen ermöglicht.

4. Intelligente Ankertext-Empfehlung: Qualität vor Quantität

Der perfekte Ankertext ist keine Geschmackssache. Er muss die Nutzerintention widerspiegeln und darf nicht generisch sein.

Wie es funktioniert: Das Skript analysiert alle Suchanfragen für eine Ziel-URL und prüft sie gegen eine interne Blacklist mit generischen Begriffen (z.B. „beliebte begriffe“, „hier klicken“). Anschließend wählt es nach einer klaren Prioritätenliste den besten Ankertext aus:

- Top-Klick-Suchanfrage (wenn nicht generisch)

- Top-CTR-Suchanfrage (wenn nicht generisch)

- H1-Überschrift & Seitentitel (als Fallback)

Das Ergebnis: Du erhältst eine einzige, direkt umsetzbare Ankertext-Empfehlung, die auf echtem Nutzerverhalten basiert und als natürlicher Ankertext direkt einsetzbar ist. Das Skript verwendet dabei eine natürliche Großschreibung (nur den ersten Buchstaben), um unnatürlich wirkende Titel-Schreibweisen wie „Seo Strategie Für Onlineshops“ zu vermeiden.

5. Bidirektionale Duplikat-Erkennung und Inlink-Analyse

Bevor die finale Empfehlungsliste erstellt wird, bereinigt das Skript die Ergebnisse um bidirektionale Duplikate: Wenn sowohl „Seite A → Seite B“ als auch „Seite B → Seite A“ als Chance erkannt wird, bleibt nur die Richtung mit dem höheren Opportunity Score erhalten. Das halbiert in der Praxis die manuelle Prüfarbeit deutlich.

Zusätzlich enthält jede Empfehlung einen Inlink-Counter – die Anzahl der bereits bestehenden internen Links auf die Zielseite. Damit erkennst du auf einen Blick, welche Seiten generell unterverlinkt sind. Eine Seite mit hohem Opportunity Score und nur zwei bestehenden Inlinks ist ein deutlich besserer Kandidat als eine, die bereits von 30 anderen Seiten verlinkt wird.

6. Kannibalisierungs-Erkennung: Wann Verlinkung nicht die Antwort ist

Nicht jede thematische Übereinstimmung ist ein Signal für eine Verlinkung. Wenn zwei Seiten eine extrem hohe Cosinus-Ähnlichkeit aufweisen (Standard: ab 0,92) und zusätzlich auf mindestens zwei identische GSC-Suchanfragen ranken, liegt mit hoher Wahrscheinlichkeit eine Keyword-Kannibalisierung vor.

- Wie es funktioniert: Das Skript vergleicht für alle hochähnlichen Seitenpaare die jeweiligen GSC-Queries und identifiziert Überschneidungen. Anschließend gibt es eine Empfehlung: Bei einer Ähnlichkeit über 0,97 wird eine Konsolidierung (Zusammenlegung) vorgeschlagen, darunter eine inhaltliche Abgrenzung der beiden Seiten.

- Das Ergebnis: Ein separates Sheet im Excel-Report listet alle Kannibalisierungsfälle mit den betroffenen URLs, der Cosinus-Ähnlichkeit, der Anzahl gemeinsamer Queries und den Top-5-Overlap-Keywords. So erkennst du, wo du vor dem Verlinken erst konsolidieren oder differenzieren solltest.

7. Hub-Page-Analyse und Orphan-Page-Erkennung

Die strategisch wertvollsten Erkenntnisse liefern oft nicht die einzelnen Link-Empfehlungen, sondern die Muster dahinter.

- Hub-Page-Analyse: Das Skript identifiziert Seiten, die besonders häufig als Zielseite empfohlen werden, aber verhältnismäßig wenige bestehende Inlinks haben. Diese Seiten sind ideale Kandidaten für eine Pillar-Page-Strategie. Der sogenannte Hub Score berechnet sich aus der Anzahl der Empfehlungen, den bestehenden Inlinks und dem durchschnittlichen Opportunity Score. Seiten mit einem hohen Hub Score sind thematische Knotenpunkte, die von einer gezielten Verlinkungsstrategie am stärksten profitieren.

- Orphan-Page-Erkennung: Seiten, die zwar gecrawlt und in den Embeddings vorhanden sind, aber in der gesamten internen Verlinkung weder als Quelle noch als Ziel auftauchen, gelten als Orphan Pages. Das Skript identifiziert diese Seiten automatisch und gibt sie in einem separaten Sheet aus. Orphan Pages sind häufig die am niedrigsten hängenden Früchte: Ein einziger interner Link kann dafür sorgen, dass eine bisher isolierte Seite von Google überhaupt erst regelmäßig gecrawlt und indexiert wird.

Das Ergebnis: Ein strukturierter Multi-Sheet-Report

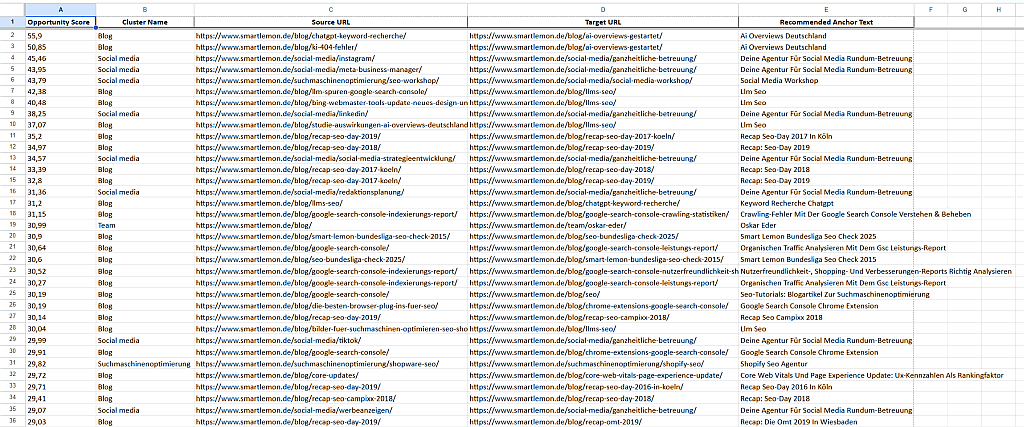

Nachdem das Skript alle Daten verarbeitet hat, generiert es einen umfassenden Excel-Report mit sieben Tabellenblättern. Jedes Sheet ist farblich kodiert und auf einen spezifischen Anwendungsfall zugeschnitten:

1. Summary: Ein Dashboard mit allen KPIs auf einen Blick – Gesamtzahl der Empfehlungen, Durchschnittlicher und maximaler Opportunity Score, Anzahl der Cluster, Kannibalisierungsfälle, Hub-Pages und Orphan Pages. Dazu eine Dokumentation der verwendeten Scoring-Gewichtung.

2. Top 50 Prioritäten: Die 50 Link-Empfehlungen mit dem höchsten Opportunity Score. Der ideale Einstiegspunkt für die Umsetzung.

3. Alle Empfehlungen: Die komplette, nach Score sortierte Liste aller identifizierten Link-Chancen mit Opportunity Score, Cluster-Zuordnung, Quell- und Ziel-URL, Ankertext-Empfehlung und der Anzahl bestehender Inlinks.

4. Nach Cluster: Dieselben Empfehlungen, aber nach Themencluster sortiert. Ideal, um gebündelt alle Link-Chancen für ein bestimmtes Themengebiet abzuarbeiten.

5. Kannibalisierung: Alle erkannten Fälle potenzieller Keyword-Kannibalisierung mit den betroffenen URLs, der Cosinus-Ähnlichkeit, den gemeinsamen Suchanfragen und einer konkreten Handlungsempfehlung.

6. Hub Pages: Potenzielle Pillar-/Hub-Pages mit Hub Score, Anzahl der Empfehlungen als Zielseite, bestehenden Inlinks und durchschnittlichem Opportunity Score.

7. Orphan Pages: Alle identifizierten Seiten ohne jegliche interne Verlinkung, gruppiert nach Verzeichnisstruktur.

In der Praxis sieht eine solche Tabelle dann wie im unten abgebildeten (fiktiven) Beispiel aus:

| Opportunity Score | Cluster Name | Source URL | Target URL | Recommended Anchor Text | Bestehende Inlinks |

|---|---|---|---|---|---|

| 95.4 | SEO – Content – Marketing | /blog/technische-seo-checkliste/ | /seo-dienstleistungen/ | Seo Agentur | 3 |

| 92.1 | SEO – Content – Marketing | /blog/was-ist-e-e-a-t/ | /seo-dienstleistungen/ | Seo Beratung | 3 |

| 88.7 | Social Media – Strategie | /blog/instagram-tipps/ | /social-media-agentur/ | Social Media Agentur | 7 |

Beachte die natürliche Schreibweise der Ankertexte: „Seo agentur“ statt „Seo Agentur“ – das Skript schreibt nur den ersten Buchstaben groß, um unnatürliche Title-Case-Ankertexte zu vermeiden. Zusätzlich zeigt die Spalte „Bestehende Inlinks“, wie viele interne Links bereits auf die Zielseite verweisen. Ein niedriger Wert bei hohem Opportunity Score signalisiert eine besonders wertvolle Verlinkungschance.

Anwendungsbeispiele aus der Praxis

Wie übersetzt sich diese Tabelle in konkrete SEO-Maßnahmen? Hier sind drei typische Anwendungsfälle:

- Bottom-of-Funnel-Seiten stärken:

- Szenario: Die Analyse zeigt mit einem hohen Opportunity Score, dass dein Blogartikel „Technische SEO-Checkliste“ thematisch extrem relevant für deine kommerzielle Seite „/seo-dienstleistungen/“ ist, aber noch nicht dorthin verlinkt.

- Maßnahme: Du öffnest den Blogartikel, fügst einen passenden Satz ein und verlinkst mit dem empfohlenen Ankertext „SEO Agentur“ auf deine Dienstleistungsseite. So leitest du qualifizierten Traffic vom informativen Content zur konvertierenden Seite.

- Neue Inhalte gezielt anschieben:

- Szenario: Du hast gerade einen neuen, ausführlichen Artikel zum Thema „Was ist E-E-A-T?“ veröffentlicht. Die Analyse zeigt, dass dieser Artikel eine hohe semantische Ähnlichkeit zu deinem bereits etablierten und starken „Content-Marketing-Guide“ hat.

- Maßnahme: Du setzt vom etablierten Guide einen Link auf den neuen Artikel. Dadurch erhält der neue Inhalt sofort einen wertvollen internen Link von einer autoritativen Seite und wird von Google schneller erfasst und als relevant eingestuft.

- Topical Authority durch Cluster-Verlinkung aufbauen:

- Szenario: Du filterst die Ergebnisliste nach dem „Cluster Name“ Blog – Social Media. Die Liste zeigt dir fünf verschiedene Blogartikel über Instagram, Facebook und LinkedIn, die alle noch nicht auf deine zentrale Pillar-Page „/social-media-agentur/“ verlinken.

- Maßnahme: Anstatt nur einen einzelnen Link zu setzen, arbeitest du die gesamte Cluster-Liste ab. Du verlinkst aus allen fünf relevanten Blogartikeln auf deine zentrale Dienstleistungsseite. Dadurch signalisierst du Google unmissverständlich, dass diese Seite das thematische Zentrum deiner Social-Media-Expertise ist.

4. Kannibalisierung erkennen und auflösen:

- Szenario: Im Kannibalisierungs-Sheet erkennst du, dass deine Seiten „/blog/was-ist-seo/“ und „/seo-dienstleistungen/“ eine Cosinus-Ähnlichkeit von 0,96 aufweisen und auf drei identische Suchanfragen ranken.

- Maßnahme: Statt beide Seiten weiter zu verlinken, prüfst du die inhaltliche Abgrenzung. Du schärfst den informativen Blogartikel auf den Wissensaspekt und die kommerzielle Seite auf die Dienstleistung. Anschließend setzt du einen gezielten internen Link vom Blog auf die Serviceseite – so leitest du den informativen Traffic auf die konvertierende Seite, ohne dass sich beide Seiten in den SERPs gegenseitig kannibalisieren.

5. Orphan Pages retten:

- Szenario: Das Orphan-Page-Sheet zeigt, dass drei deiner Blogartikel aus dem letzten Jahr keinerlei interne Verlinkung haben – weder eingehend noch ausgehend.

- Maßnahme: Du prüfst, ob die Inhalte noch aktuell sind und integrierst sie über gezielte interne Links in die Seitenarchitektur. Häufig reicht ein einziger relevanter Link von einer thematisch verwandten Seite, um eine Orphan Page wieder in den Google-Index zu bringen.

6. Hub Pages gezielt stärken:

- Szenario: Die Hub-Page-Analyse zeigt, dass deine Seite „/social-media-agentur/“ von acht verschiedenen Blogartikeln als Verlinkungsziel empfohlen wird, aber aktuell nur zwei Inlinks hat.

- Maßnahme: Du arbeitest alle acht Empfehlungen systematisch ab und machst die Seite zum thematischen Zentrum deines Social-Media-Clusters. Die hohe Anzahl relevanter Inlinks signalisiert Google, dass diese Seite die zentrale Autorität für das Thema ist.

Fazit

Dieser Workflow transformiert die interne Verlinkung von einer reaktiven Fleißaufgabe in einen proaktiven, strategischen Prozess. Anstatt im Dunkeln zu stochern, triffst du datengestützte Entscheidungen, die die thematische Relevanz deiner Website gezielt stärken, die Nutzerführung verbessern und letztlich deine Sichtbarkeit in den Suchergebnissen nachhaltig steigern.

Mit der erweiterten Analyse geht das Skript dabei über reine Link-Empfehlungen hinaus: Die Kannibalisierungs-Erkennung zeigt dir, wo du vor dem Verlinken erst Inhalte konsolidieren solltest. Die Hub-Page-Analyse identifiziert deine thematischen Knotenpunkte, die von einer gezielten Verlinkungsstrategie am stärksten profitieren. Und die Orphan-Page-Erkennung deckt vergessene Inhalte auf, die mit minimalem Aufwand wieder in die Seitenarchitektur integriert werden können.

Weiterführende Quellen und Informationen zur internen Link-Matrix mit KI und GSC-Daten

- Sven Giese: Google Colab Notebook mit dem Internal Linking Analysis Script für SMART LEMON (deutsch/mehrsprachig)

- Everett Sizemore: How I Found Internal Linking Opportunities With Vector Embeddings – auf: moz.com am 3. Oktober 2024 (englisch)

- Gus Pelogia: Using the Screaming Frog SEO Spider and OpenAI Embeddings to Map Related Pages at Scale – auf: screamingfrog.co.uk am 23. September 2024 (englisch)

- Mike King: SEO Use Cases for Vectorizing the Web with Screaming Frog – auf: ipullrank.com am 5. August 2024 (englisch)

- Britney Mullers Original Python Script “SF Internal Link Opportunities” als Google Colab Notebook (englisch)

- Ana Pérez: Internal Linking Guide for SEO with Google Colab (Python) – auf: anaperezbotella.com (englisch/spanisch)

- Raffaele Visintin: Embeddings, Seo & Screaming Frog – auf: screamingfrog.club (englisch/mehrsprachig)

- Die offizielle Website der Google Sheets Erweiterung: Search Analytics for Sheets (englisch)

- Website der Sheets-Extension SEO Sheets (englisch)

Sven ist ein echtes SMART LEMON Urgestein. Er ist seit 2012 bei uns und war der erste Mitarbeiter der Agentur. Als Head of SEO & GEO leitet er das SEO- & GEO-Team und verantwortet in diesem Bereich das Tagesgeschäft. Außerdem bildet er Kolleg:innen in Sachen Suchmaschinenoptimierung aus. Den Großeltern kann man das so erklären: Sven macht was mit Computern. Und mit Nachdenken 😉