- Home

- Blog

- LLM‑Temperatur 0.0: Wie ChatGPT & Co deine Marke wirklich bewerten

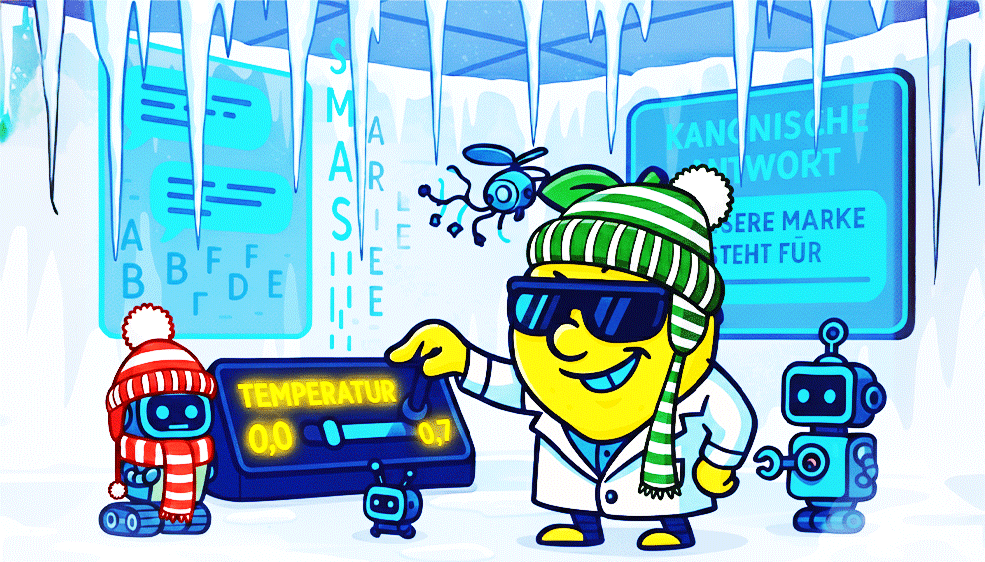

Warum gibt ChatGPT ständig andere Antworten, wenn ich wissen will, wofür unsere Marke steht? Kurze Antwort: wegen der Temperatur. Dieser LLM-Parameter steuert die Zufälligkeit der Ausgaben. Bei der üblichen Standardeinstellung 0,7 variiert die Antwort. Stellst du die Temperatur auf 0,0, wird das Modell deterministisch und wählt bei jedem Schritt das wahrscheinlichste nächste Token. Genau dann zeigt sich, was die KI als „kanonisches“ Wissen über deine Marke betrachtet.

Nicht nur aus SEO-Sicht ein spannender Ansatz. Denn das lässt sich sehr gezielt testen. Maskiere zentrale Begriffe oder baue Lückentexte ein, etwa den Markennamen oder den Claim, und lass das Modell die Lücke füllen. Bei Temperatur 0,0 erhältst du klare, reproduzierbare Aussagen dazu, welche Inhalte ChatGPT und Co mit deiner Marke verbinden. Das ist sofort nutzbar für SEO, Brand-Strategie und Content-Teams, in B2B wie B2C. In diesem Artikel zeige ich dir, wie du den 0,0-Test aufsetzt und die Ergebnisse auswertest – damit du endlich siehst, wie die Modelle deine Marke wirklich bewerten.

TL;DR

- Temperatur 0.0 = maximale Deterministik. Das Modell gibt bei jedem Token das wahrscheinlichste Wort aus – keine Zufallskomponent

- Schneller Markencheck. Siehe in Sekunden, welche Attribute die KI am häufigsten nennt.

- Bias erkennen. Temperatur 0.0 legt eingeschliffene Vorurteile offener als jede andere Einstellung.

- Lückenanalyse gegenüber Wettbewerbern.

- Aber: Deterministische Antworten ≠ Faktencheck – sie spiegeln nur die statistisch wahrscheinlichste Version der Wahrheit wider.

Was bedeutet die Temperatureinstellung bei LLMs?

Die Temperature ist ein Parameter, der reguliert, wie zufällig oder vorhersehbar die Antworten eines Large Language Models (LLM) ausfallen. Im Sampling‑Prozess skaliert temperature die Logit‑Werte vor der Softmax. Je niedriger der Wert, desto steiler die Wahrscheinlichkeitsverteilung. Das Modell „spielt auf Sicherheit“ und wiederholt die statistisch naheliegendste Fortsetzung.

Analogie: Stell dir einen Würfel vor, dessen Augenzahl die nächste Token‑Wahl repräsentiert. Hohe Temperatur würfelt mit sechs gleichwahrscheinlichen Seiten, niedrige Temperatur schleift die Kanten ab, bis im Extrem die „6“ auf jeder Seite steht.

Definition Temperatureinstellung bei LLMs

Alternativ kannst du dir diesen Wert auch als eine Art von Kreativitätsregler vorstellen:

- Hohe Temperatur (z. B. 1,0): Das LLM „würfelt“ mehr bei der Wortwahl. Die Antworten werden kreativer und variieren stärker – können aber manchmal inkonsistent oder abschweifend sein.

- Mittlere Temperatur (z. B. 0,5): Ein ausgewogener Mittelweg. Die Antworten sind relativ präzise, aber immer noch mit etwas Variation. Gut für viele Anwendungsfälle, in denen sowohl Korrektheit als auch Kreativität zählen.

- Temperatur 0,0: Absolut deterministisch. Das Modell wählt strikt das wahrscheinlichste nächste Wort aus und liefert so jedes Mal dieselbe Antwort auf die gleiche Frage. Es wird vom kreativen Geschichtenerzähler zum sachlichen Wissensextraktor. Diese Einstellung ist ideal, wenn du eine eindeutige, unverfälschte Analyse suchst. Zum Beispiel, um klar zu sehen, welche Begriffe und Fakten die KI am stärksten mit deiner Marke assoziiert.

Hinweis: In vielen Chat-Interfaces ist die Temperatureinstellung standardmäßig um ~0,7. Für unseren Zweck musst du sie explizit auf 0,0 setzen, z. B. im API-Tool oder einem KI-Editor, der Temperatureingaben erlaubt.

LLM-Kochbuch: einige Anwendungen und Beispiele aus der Praxis

| Temperaturwert | Ergebnis | Typische Use-Cases |

|---|---|---|

| 0 – 0,3 | Fast vollständig deterministisch | Übersetzung, Klassifikation, Datenbereinigung |

| 0,4 – 0,6 | Ausgewogen zwischen Genauigkeit und Varianz | Blog-Einleitungen, Produkttexte |

| 0,7 – 1,0 | Hohe Kreativität, starke Varianz | Storytelling, Copywriting, Ideen für Kampagnen |

Grenzen und Stolperfallen beachten

So hilfreich der deterministische KI-Check ist, man muss seine Grenzen kennen:

- Determinismus ≠ Wahrheit: Nur weil die Antwort konsistent ist, heißt es nicht, dass sie faktisch korrekt ist. Das LLM gibt bei Temperatur 0,0 die wahrscheinlichste Antwort aus – aber die beruht auf vergangenen Trainingsdaten und kann veraltet oder unvollständig sein. Verwende diese Methode also für Analysen, nicht um unbestätigte Fakten abzuleiten. Einen echten Faktencheck musst immer noch du selbst oder externe Quellen durchführen.

- Kontextabhängigkeit: KI-Antworten (sogar deterministische) sind stark vom Prompt abhängig. Schon kleine Änderungen in der Frage können andere Formulierungen oder Details hervorbringen. Beispiel: „Erzähle mir von Firma X“ vs. „Was bietet Firma X an?“ könnte Nuancen verändern. Lass dich davon nicht verwirren, sondern halte deine Prompts für Vergleiche möglichst einheitlich. Und bedenke: Die Ergebnisse zeigen, was das Modell im jeweiligen Kontext für relevant hält – es ist kein objektives Urteil in Stein gemeißelt.

- Aktualität: LLMs besitzen kein Wissen über Ereignisse nach ihrem Trainingsdatum. Antworten bei Temperatur 0,0 reflektieren den Informationsstand des Modells (häufig Ende 2021 oder 2022, je nach Modell). Das bedeutet, dass neueste Entwicklungen, Kampagnen oder Re-Brandings deinerseits unberücksichtigt bleiben können. Wenn du kürzlich eine große Neuerung hattest und diese nicht auftaucht, liegt es vielleicht nur am Cut-off-Date – aber genau dann solltest du umso mehr aktuellen Content erstellen, um beim nächsten Modell-Update präsent zu sein.

Warum Temperatur 0,0 dein SEO-Frühwarnsystem ist

Mit Temperatur 0,0 kannst du die KI wie ein Frühwarnsystem für deine Marke nutzen. Die deterministischen Antworten zeigen dir, wo deine Markenkommunikation aus Sicht der KI steht. Das sind wertvolle Hinweise, noch bevor sich Trends in Suchergebnissen oder Kundenwahrnehmungen manifestieren. Hier die drei größten Vorteile im Überblick:

- Klarheit über Markenbotschaften: Bei Temperature 0.0 erfährst du genau, welche Markenattribute und Produktmerkmale die KI am stärksten mit deiner Marke verbindet. Tauchen in der Antwort z. B. immer wieder deine Kernbotschaften und USPs auf? Perfekt – dann scheinen diese in der verfügbaren Informationsbasis verankert zu sein. Fehlen jedoch wichtige Botschaften, ist das ein klares Signal, diese in deiner Content-Strategie stärker zu gewichten. Beispiel: Wenn du dich als innovatives Tech-Unternehmen siehst, die KI aber nur über „Zuverlässigkeit und Service“ spricht, musst du Inhalte schaffen, die Innovation betonen. Diese Klarheit hilft dir, deine Markenkommunikation gezielt zu verbessern und Inkonsistenzen auszubügeln.

- Aufdecken von impliziten Vorurteilen: KI-Antworten bei Temperatur 0,0 legen schonungslos offen, welche Biases im Modell oder im Trainingsdatensatz schlummern. Zeigt die KI z. B. überwiegend Beispiele aus einem einzigen Land? Werden in den Antworten hauptsächlich männliche Führungskräfte genannt und Frauen oder diverse Gruppen gar nicht? Solche impliziten Vorurteile erkennst du sofort. Für Marken bedeutet das: Du siehst, ob die Darstellung einseitig ist – etwa ob dein Unternehmen immer nur in einem bestimmten Kontext erwähnt wird. Diese Einsichten sind Gold wert, um gegen z. B. regionale Scheuklappen oder ein verzerrtes Image anzugehen. Wenn die KI deine globale Marke z. B. nur mit der DACH-Region verbindet, solltest du überlegen, mehr internationalen Content zu produzieren. Kurz: Temperature 0,0 enthüllt die voreingestellten Annahmen der KI zu deiner Marke und Branche (Kultur, Herkunft, Geschlecht etc.).

- Entdecken semantischer Beziehungen: Ein riesiger Vorteil deterministischer Antworten ist, dass sie dir die engsten semantischen Verbindungen zeigen. Formuliere z. B. den Prompt „[Branche] steht für …“ oder „[Deine Marke] steht für …“ bei Temperatur 0,0. Die Begriffe, die nun erscheinen, sind die stärksten thematischen Ankerpunkte, die das LLM kennt. So erfährst du, welche Themen, Werte oder Keywords besonders eng mit deiner Marke oder Branche verknüpft sind. Das kann sowohl Bestätigung liefern („Gut, KI nennt direkt Qualität und Nachhaltigkeit bei unserer Marke, das sind genau unsere Kernwerte!“) als auch Überraschungen aufdecken („Interessant, KI assoziiert uns stark mit Thema X, obwohl wir das kaum kommunizieren – vielleicht steckt da ungenutztes Potenzial?“). Für deine LLM-SEO-Strategie bedeutet das: Du erkennst, welche Begrifflichkeiten im Kontext deiner Marke als Kanon gelten, und kannst Content darum herum planen, um diese Verbindungen zu stärken oder unerwünschte Assoziationen umzulenken.

Tipp: Diese Vorteile gelten branchenübergreifend. Ob B2C-Modemarke oder B2B-Softwareanbieter – in beiden Fällen zeigt dir der deterministische KI-Output, welche Botschaften ankommen. B2C-Marken sehen vielleicht, dass KI immer Attribute wie „preiswert“ oder „trendy“ nennt, während B2B-Marken Begriffe wie „innovativ“ oder „verlässlich“ erwarten. In allen Fällen gilt: Was die KI nicht nennt, ist ebenso aufschlussreich!

Praxisbeispiele für Temperature 0.0 im SEO-Alltag

Genug Theorie – wie setzt du LLM Temperatur 0,0 nun gezielt ein? Hier drei praktische Beispiele, die du in 30 Sekunden ausprobieren kannst. Achte aber darauf, dass du alle Prompts immer mit Temperature = 0,0 nutzt!1 ▸ Schnelltest Marke

Tell me about {DEINE MARKE}. (bzw. „Erzähle mir von [Deine Marke]“, falls das LLM Deutsch spricht.)

Analyse: Dies ist der Default-Test für deine Marke. Schau genau hin, welche Punkte die KI in der Antwort aufzählt. Werden deine wichtigsten Botschaften und Alleinstellungsmerkmale erwähnt? Kommen z.B. deine Top-Produkte, dein Gründungsjahr, deine Branchenzugehörigkeit und andere Schlüssel-Infos vor? Wenn ja, sind diese offensichtlich fest im KI-Wissensschatz verankert – ein gutes Zeichen. Falls nein, hast du wertvolle Erkenntnisse gewonnen: Offenbar fehlen diese Punkte in den Daten, die das LLM über dich hat.

Handlungsempfehlung: Sorge dafür, dass du genau zu diesen Themen Content erstellst oder optimierst. Beispielsweise könnte ein B2B-Unternehmen feststellen, dass die KI nichts über seine innovativste Technologie erwähnt – ein klares Signal, mehr dazu zu publizieren. Eine B2C-Marke im Fashion-Bereich könnte merken, dass KI ihre Nachhaltigkeitsinitiativen nicht nennt – also Content-Lücke identifiziert! Kurz: Der Marken-Check zeigt dir, ob dein gewünschtes Markenbild bereits in der KI-Welt vorhanden ist, oder ob du nachschärfen musst.

2 ▸ Lückenanalyse Wettbewerb

Tell me about {KONKURRENT X}.

Nimm denselben Prompt wie oben – „Tell me about [Deine Marke]“ bei Temp 0.0 – und wende ihn auf deine Hauptwettbewerber an. Also: „Tell me about [Wettbewerber A]“, „… about [Wettbewerber B]“ usw. Notiere dir die Antworten oder stelle sie gegenüber.

Analyse: Erstelle nun eine übersichtliche Gegenüberstellung (z.B. in Tabellenform): Welche Punkte, Stärken oder Themen tauchen bei den Wettbewerbern auf, die bei deiner Marke fehlen? Vielleicht erwähnt die KI bei Wettbewerber A eine starke Community oder bei Wettbewerber B ein preisgekröntes Produkt, das in deiner Antwort nicht vorkommt. Diese Differenzen sind deine Content-Lücken. Überlege, warum diese Aspekte fehlen – liegt es daran, dass dein Unternehmen in dem Bereich tatsächlich weniger tut, oder nur daran, dass darüber online wenig steht?

Handlungsempfehlung: Nutze diese Erkenntnisse, um gezielt neuen Content zu erstellen und Lücken zu schließen. Wenn der KI-Output deinen Konkurrenten für etwas lobt (z.B. exzellenten Kundenservice oder Thought-Leadership in einem Thema) und bei dir schweigt, dann arbeite genau daran: Erstelle Inhalte, die eure Kompetenz auf diesem Gebiet beweisen (Case Studies, Blogartikel, Testimonials etc.). So stärkst du langfristig dein Profil – und vermutlich taucht es beim nächsten KI-Update dann auch in deiner Markenbeschreibung auf.

3 ▸ Authority‑Check

Führende Unternehmen im Bereich {BRANCHE} sind …

Analyse: Wird deine Marke unter den Top-Namen genannt? Dieser Prompt deckt auf, wen die KI als Autoritäten oder Top-Player in deiner Branche betrachtet. Falls deine Marke nicht auftaucht, solltest du dringend an Content und PR arbeiten, die deine Autorität im Markt stärken. Möglicherweise fehlen dir umfangreiche Branchenguides, Studien, Erfolgsstorys oder Medienpräsenz, die dich als führenden Akteur positionieren. Überlege auch, zu welchen Themen die genannten Mitbewerber viel Präsenz zeigen – und ob du in diesen Bereichen inhaltlich nachziehen kannst. Erscheint deine Marke jedoch in der KI-Liste der führenden Unternehmen, Glückwunsch! Dann hast du zumindest im KI-Modell bereits einen gewissen Autoritätsstatus.

Handlungsempfehlung: Egal wie das Ergebnis ausfällt – nutze es als Motivation. Entweder um aufzuholen (wenn du fehlst) oder um diese Führungsposition weiter auszubauen, indem du regelmäßig hochwertige Inhalte lieferst, die genau die Themen der Branche abdecken, nach denen Nutzer und KI suchen.

Übrigens: Den Authority-Check kann man auch variieren, z. B. mit Prompts wie „Trusted sources for [Thema] include …“ oder „Laut Experten im Bereich [Branche] …“. Je nachdem, ob man eher Fachmedien/Zitierungen prüfen will oder allgemeine Branchenwahrnehmung.

Branchen‑Prompts (B2B & B2C)

Die folgende Tabelle liefert dir praxiserprobte Prompt‑Vorlagen für vier gängige Szenarien aus B2B und B2C. Nutze sie, um ohne Umwege herauszufinden, welche Botschaften die KI in den jeweiligen Branchenkontexten priorisiert. Aber natürlich auch, wo noch Potenzial zur Content‑Optimierung für deine Marke liegt.| Branche | Prompt | Nutzen |

|---|---|---|

| SaaS (B2B) | List common pain points for CFOs addressed by {MARKE}. | Produkt-Messaging aus CFO-Sicht validieren |

| Dienstleistung (B2B) | Why do companies choose {MARKE} consulting over in-house teams? | Positionierung & USPs |

| E-Commerce (B2C) | What makes {MARKE} stand out among online fashion retailers? | Differenzierung |

| FMCG (B2C) | Describe the brand personality of {MARKE} snack bars. | Markenimage prüfen |

Hands‑on: Google Sheets‑Integration mit Apps Script

Du willst Temperatur‑Tests direkt im Spreadsheet fahren? Mit den folgenden Apps‑Script‑Snippets kannst du OpenAI‑, Google Gemini‑ und Anthropic Claude‑Modelle in Zellen aufrufen. Platzhalter für API‑Keys bitte anpassen.1 ▸ OpenAI (gpt‑4o mini u. a.)

/**

* Ruft die OpenAI API mit einem bestimmten Prompt auf.

*

* @param {string} prompt Der Text, der an die KI gesendet werden soll.

* @param {number} temperature Die Kreativität der Antwort (0.0 - 2.0).

* @param {string} model Das zu verwendende OpenAI-Modell (z.B. "gpt-4o-mini").

* @return Die Textantwort von der OpenAI API.

* @customfunction

*/

function AI_OpenAI(prompt, temperature = 0.3, model = "gpt-4o-mini") {

// PRÜFUNG: Verhindert den API-Aufruf, wenn der Prompt leer ist.

if (!prompt || prompt.trim() === "") {

return "Bitte geben Sie einen Prompt ein.";

}

const OPENAI_KEY = "DEIN_OPENAI_KEY_HIER_EINFÜGEN";

const MAX_TOKENS = 800;

const url = "https://api.openai.com/v1/chat/completions";

const payload = {

model: model,

messages: [

{ role: "system", content: "You are a helpful assistant." },

{ role: "user", content: prompt },

],

temperature: temperature,

max_tokens: MAX_TOKENS,

};

const options = {

method: "post",

contentType: "application/json",

headers: { Authorization: "Bearer " + OPENAI_KEY },

payload: JSON.stringify(payload),

muteHttpExceptions: true, // Wichtig, um die volle Fehlermeldung zu sehen!

};

try {

const response = UrlFetchApp.fetch(url, options);

const res = JSON.parse(response.getContentText());

// Prüfen, ob die Antwort einen Fehler enthält

if (res.error) {

return "API Fehler: " + res.error.message;

}

return res.choices[0].message.content.trim();

} catch (e) {

return "Fehler bei der Ausführung: " + e.toString();

}

}

2 ▸ Google Gemini (1.5 Pro / Flash)

/**

* Ruft die Gemini API mit einem bestimmten Prompt und einer Temperatur auf.

*

* @param {string} prompt Der Text, der an die KI gesendet werden soll.

* @param {number} temperature Die Kreativität der Antwort (0.0 - 1.0). 0.0 ist am deterministischsten.

* @return Die Textantwort von der Gemini API.

* @customfunction

*/

function AI_Gemini(prompt, temperature = 0.0) {

// Gib sofort eine Lade-Nachricht zurück, da der API-Aufruf dauern kann

if (prompt === "") {

return "Bitte geben Sie einen Prompt ein.";

}

// Hier deinen API-Key sicher speichern und abrufen

const GEMINI_KEY = "AIzaSyCGzOFSAFCAevPQ7KQer03VYk1GLC4Y1p8";

const model = "models/gemini-1.5-pro-latest";

const MAX_TOKENS = 2048; // Ein Standardwert für die maximale Länge der Antwort

const url = `https://generativelanguage.googleapis.com/v1beta/${model}:generateContent?key=${GEMINI_KEY}`;

const payload = {

contents: [{

parts: [{

text: prompt

}]

}],

generationConfig: {

temperature: temperature,

maxOutputTokens: MAX_TOKENS, // Korrekter Parametername ist maxOutputTokens

},

};

const options = {

method: "post",

contentType: "application/json",

payload: JSON.stringify(payload),

muteHttpExceptions: true // Wichtig, um Fehlerdetails zu erhalten

};

try {

const response = UrlFetchApp.fetch(url, options);

const res = JSON.parse(response.getContentText());

if (res.candidates && res.candidates[0].content.parts[0].text) {

return res.candidates[0].content.parts[0].text.trim();

} else {

// Gibt eine detailliertere Fehlermeldung zurück, falls die API-Antwort unerwartet ist

return "Fehler: Unerwartete API-Antwort. Details: " + JSON.stringify(res);

}

} catch (e) {

return "Fehler beim API-Aufruf: " + e.toString();

}

}

3 ▸ Anthropic Claude (Claude 3 Haiku u. a.)

const CLAUDE_KEY = "DEIN_ANTHROPIC_API_KEY";

function AI_Claude(prompt, temperature = 0.3, model = "claude-3-haiku-20240307") {

const url = "https://api.anthropic.com/v1/messages";

const payload = {

model: model,

max_tokens: MAX_TOKENS,

temperature: temperature,

messages: [{ role: "user", content: prompt }],

};

const options = {

method: "post",

contentType: "application/json",

headers: {

"x-api-key": CLAUDE_KEY,

"anthropic-version": "2023-06-01",

},

payload: JSON.stringify(payload),

};

const res = JSON.parse(UrlFetchApp.fetch(url, options).getContentText());

return res.content[0].text.trim();

}

Beispielaufrufe in Sheets

=AI_OpenAI("Tell me about ";0;"gpt-4o-mini")

=AI_Gemini("Tell me about ", 0.0)

=AI_Claude("Tell me about " & A3, 0.0)

Schnell testen im Browser

Du willst Temperatur‑Checks ohne Installation sofort ausprobieren? Dann nutze eines der folgenden Web‑Tools und setze Temperature auf 0,0:

- Google AI Studio – wähle etwa Gemini 1.5 Flash oder Gemini 1.5 Pro, Temperatur 0,0, Prompt einfügen, Antwort prüfen (siehe Beispiel unten).

- OpenAI Playground – Modell gpt-4o, Temperatur 0,0, Prompt einfügen, fertig.

- Anthropic Claude Playground – Modell claude-3-haiku-20240307 (oder aktuelles Claude-3‑Modell), Temperatur 0,0 wählen, Prompt einfügen, Ergebnis prüfen.

- Perplexity Labs – unter „Custom“ oder im Einstellungsfeld die Temperatur auf 0,0 setzen, Prompt einfügen und mit höheren Werten vergleichen.

So merkst du sofort, wie sich Temperatur 0,0 „anfühlt“, und die deterministischen Ergebnisse mit kreativ höheren Werten vergleichen.

Best Practices und Tipps

Bevor du loslegst, hier eine kurze Checkliste bewährter Vorgehensweisen, damit du das Meiste aus LLM Temperatur 0.0 herausholst:

- Kombiniere verschiedene Temperaturwerte: Nutze Temperatur 0,0 gezielt für Analysen (Marken-Check, Vergleiche, Bias-Findung) – aber für kreative Aufgaben oder Brainstorming sind höhere Werte (0,3–0,7) besser geeignet. Beide Modi haben ihren Platz. Erst deterministisch Erkenntnisse gewinnen, dann mit kreativerer KI neue Ideen entwickeln.

- Regelmäßige Überprüfung: Wiederhole deine Analysen in regelmäßigen Abständen, insbesondere nach jedem größeren Modell-Update. Die KI lernt zwar nicht „live“ dazu, aber neue Modellversionen oder Trainingsdaten können die Ergebnisse verändern. Was heute noch fehlt, könnte in sechs Monaten auftauchen – und umgekehrt. Bleib also am Ball und behalte die AI-Perspektive auf deine Marke im Auge.

- Ergebnisse dokumentieren: Halte deine Erkenntnisse übersichtlich fest – zum Beispiel in einer Tabelle. Notiere Prompts, die KI-Antworten bei Temp 0,0 für deine Marke und Wettbewerber, und das Datum. So kannst du Veränderungen über die Zeit verfolgen und behältst den Überblick, welche Inhalte du bereits optimiert hast. Ein solcher „KI-Markenaudit“-Report kann auch dem Team oder Kunden gegenüber den Handlungsbedarf verdeutlichen.

- Externe Validierung: Verlasse dich nicht blind auf die KI. Jede Erkenntnis aus dem Temperature-0.0-Check sollte durch externe Recherchen gestützt werden. Wenn die KI z. B. kein bestimmtes Produkt von dir erwähnt, prüfe, ob das vielleicht daran liegt, dass es in der öffentlichen Wahrnehmung (Suchvolumen, Social Media, Presse) tatsächlich unter dem Radar fliegt. Oder wenn Biases sichtbar werden (etwa geografisch), validiere das mit deinen Web-Analytics-Daten oder Kundenfeedback. Die KI bietet Hinweise – die Interpretation und richtigen Schlüsse liegen bei dir.

Bonus-Tipp: Nutze verschiedene Formulierungen und auch mal unterschiedliche Modelle, um Muster zu bestätigen. Wenn GPT-4 und Claude beide bei 0.0 ähnliche Lücken oder Biases zeigen, ist das ein starker Hinweis darauf, dass es nicht zufällig ist.

Semantische Triples – von Insights zu strukturiertem Wissen

Deterministische Antworten bei Temperature 0,0 liefern klare Aussagen. Doch wie überführst du diese Erkenntnisse in eine maschinenlesbare Wissensbasis? Genau hier setzt unser SMART LEMON Semantic Triple Builder an. Das Custom‑GPT‑Tool extrahiert automatisch Subject-Predicate-Object‑Triples aus beliebigen Marken‑ oder Produktinhalten (Texte, PDFs, URLs, CSVs), versieht sie mit Confidence‑Labels (🟢 hoch, 🟡 mittel, 🔴 niedrig) und exportiert sie als CSV, JSON‑LD oder Markdown.Warum Triples?

- Schema‑Mark‑up & SEO: Suchmaschinen verstehen strukturierte Daten besser, FAQ‑Rich‑Snippets inklusive.

- Omnichannel‑Consistency: Ein zentrales Triple‑Set kann PIM‑, DAM‑ oder CMS‑Systeme beliefern.

- Automatisierte FAQ‑Generierung: Aus bestätigten Triples lassen sich Frage‑Antwort‑Paare ableiten – perfekt für Help‑Center oder Voice‑Assistenten.

Workflow in 4 Schritten

- Analyse‑Vorschau: Builder liest den Inhalt ein und präsentiert erkannte Triples übersichtlich.

- Freigabe & Bereinigung: Du mergst Dubletten, löst Konflikte oder bearbeitest Formulierungen.

- Export: Wähle CSV, JSON‑LD oder Markdown und lade das Ergebnis direkt herunter.

- (Optional) FAQ‑Ableitung: Ein Knopfdruck erzeugt FAQ‑Paare aus den bestätigten Triples.

Praxis‑Tipp: Verknüpfe Temperatur‑0,0‑Prompts mit dem Triple‑Builder. Lass die KI z. B. deterministisch deine Marken-USPs aufzählen, kopiere den Output in den Builder und erhalte sofort SEO‑fertige JSON‑LD‑Triples.

Probabilistisches Prompt‑Set – Markenwahrnehmung unter Varianz testen

Während Temperature 0,0 die wahrscheinlichste KI‑Antwort liefert, zeigt ein probabilistisches Prompt‑Set (Temperature ≈ 0,6 – 0,8) die ganze Bandbreite möglicher Einschätzungen. So erkennst du:

- Variabilität der Botschaften: Ob Kern‑USPs konsistent auftauchen oder nur gelegentlich.

- Emotionale Färbung: Wie positiv, neutral oder kritisch die Tonalität schwankt.

- Reputationsrisiken: Welche negativen Aspekte sporadisch genannt werden und dadurch potenzielle Schwachstellen offenlegen.

Aufbau eines Prompt‑Sets in 3 Schritten

- Themenfelder definieren: USP‑Prüfung, Preis‑Leistung, Wettbewerb, Emotionalität und Risiken.

- 20 gezielte Fragen formulieren: Je Themenfeld 3–4 Prompts.

- 2‑Phasen‑Test: Zuerst Temperatur 0,0 für Klarheit, dann Temperatur 0,7 für Varianz – Unterschiede auswerten.

Beispiel‑Prompts aus der Praxis (verkürzt)

| Ziel | Beispiel-Prompt | Erläuterung |

|---|---|---|

| USP-Check | Was macht {MARKE} einzigartig? | Prüft Alleinstellungsmerkmale |

| Überblick Mitbewerber | Im Markt für {BRANCHE} in {STANDORT} sind die wichtigsten zehn Marken oder Unternehmen, die in den vergangenen Jahren besonders häufig in Fachartikeln, Tests und Vergleichen genannt wurden, in alphabetischer Reihenfolge: | Übersicht Mitbewerber |

| Vergleich | Welcher Akteur der {INDUSTRIE} bietet mehr Wert: {MARKE} oder {WETTBEWERBER}? | Zeigt relative Wahrnehmung |

| Preis-Leistung | Sind die Preise von {MARKE} gerechtfertigt? | Deckt Preis-Narrative auf |

Fazit: Klarheit statt Zufall

Mit LLM Temperatur 0,0 erhältst du einen schnellen und zuverlässigen Marken‑Check aus KI‑Sicht – Teil eines KI-Brand-Monitorings. Statt zufällig variierender Antworten zeigt dir das Modell die „Default‑Einstellung“ zu deiner Marke. Das ist perfekt, um Optimierungsbedarf offenzulegen.

Doch Klarheit ist nur der erste Schritt:

- Semantic Triple Builder: transformiere die deterministischen Insights in sauber strukturierte Subject‑Predicate‑Object‑Triples.

- Probabilistisches Prompt‑Set: fahre anschließend denselben Fragenkatalog mit Temperature 0,6–0,8, um die Bandbreite möglicher Wahrnehmungen abzudecken, emotionale Nuancen aufzuspüren und Reputationsrisiken zu identifizieren.

Die Kombination aus deterministischer Analyse → strukturiertem Wissen → probabilistischer Varianz macht deine Markenstrategie sowohl präzise als auch robust. Ob SEO‑Profi, Markenmanager oder Content‑Creator – mit diesem Dreiklang steigerst du Sichtbarkeit in ChatGPT & Co., Konsistenz und Glaubwürdigkeit deiner Marke.

Unsere Empfehlung: Starte heute einen 30‑Sekunden‑Check mit Temperature 0,0, exportiere die Top‑Triples und vergleiche sie mit den Ergebnissen eines 0,7‑Runs. Du wirst sofort sehen, wo du nachschärfen musst – und hast gleichzeitig das Rohmaterial für deine nächste FAQ‑Sektion oder JSON‑LD‑Einbindung.

Am Ende gilt: Nur wer weiß, wie KI die Marke sieht, kann aktiv beeinflussen, wie Millionen AI‑Nutzer sie wahrnehmen. Probier es aus – Klarheit kostet dich Sekunden, zahlt sich aber langfristig in strategischem Content und besserem Ranking aus.

Weiterführende Informationen und Quellen zur LLM-Temperatur 0,0

- „The Temperature Zero Trick: How to Discover What LLMs Really Know About Any Company in 30 Seconds“ – Metehan Yesilyurt, 16.07.2025 (englisch)

- Kurzerklärung von OpenAI zum Temperature-Parameter in der API-Dokumentation sowie FAQ-Eintrag „How should I set the temperature parameter?„ (englisch)

- Anthropic-Dokumentation zur Temperatur (englisch)

- „Prompt-Tipp: Parameter “Temperature” bei ChatGPT“ – Artikel auf aijournalist.de, 03.08.2025 (deutsch)

Online-Tools zum Ausprobieren:

Sven ist ein echtes SMART LEMON Urgestein. Er ist seit 2012 bei uns und war der erste Mitarbeiter der Agentur. Als Head of SEO & GEO leitet er das SEO- & GEO-Team und verantwortet in diesem Bereich das Tagesgeschäft. Außerdem bildet er Kolleg:innen in Sachen Suchmaschinenoptimierung aus. Den Großeltern kann man das so erklären: Sven macht was mit Computern. Und mit Nachdenken 😉